Le centre de données belge de Google est entièrement alimenté par sa propre centrale solaire et l'équipement est refroidi par l'eau du canal le plus proche - économie et efficacité énergétique en altitude. Source: Google

Depuis le début de la construction massive de centres de données, 25 ans se sont écoulés et le marché est très loin de la saturation - chaque année, les investissements mondiaux dans la construction de centres de données augmentent de 15%. Dans le même temps, les centres de données deviennent de plus en plus puissants et coûteux. Le coût de construction et d'exploitation affecte directement le prix des services numériques, tels que l'hébergement, le stockage en nuage et l'informatique, de sorte que tout le monde est intéressé par l'amélioration de l'efficacité et de l'économie des centres de données du monde entier. Quelles mesures peuvent être prises pour réduire le coût des services du centre de données?

Haute technologie à forte consommation d'énergie

Selon le magazine Nature , il faut environ 200 TWh pour alimenter les centres de données dans le monde, dont 140 TWh provenant des centres de données américains. Il y a six ans, les data centers ne consommaient que 91 TWh, soit une croissance impressionnante de 220%. Désormais, les data centers consomment plus que l'ensemble de l'Ukraine (122 TWh), de l'Argentine (129 TWh), de la Suède (134 TWh) ou de la Pologne (150 TWh).

Malgré le fait que les centres de données ne fument pas la pipe et les déchets dangereux, mais le cloud computing, ils laissent également une empreinte carbone sérieuse dans l'écologie mondiale - à propos0,3% des émissions mondiales, ce qui est beaucoup. En effet, la part d'énergie «verte» dans les principaux pays qui détiennent des centres de données est très faible (11% aux États-Unis, 26% en Chine, tous y compris les centrales hydroélectriques), de sorte que des centrales au gaz et au charbon sont utilisées pour alimenter les centres de données. En conséquence, les écologistes et les gouvernements européens sont mécontents de la croissance des émissions de gaz à effet de serre, les gestionnaires de réseau sont mécontents de la charge croissante et de la nécessité de moderniser les réseaux, les propriétaires de centres de données sont mécontents du coût de la maintenance.

Après les dépenses d'exploitation, le principal poste de maintenance du centre de données est l'électricité, qui peut représenter jusqu'à la moitié des coûts. Pour évaluer l'efficacité énergétique des data centers, on utilise le coefficient PUE (Power usage effective), qui exprime le rapport de toute l'électricité consommée à la consommation des équipements informatiques. Un PUE égal à 1.0 est idéal et inaccessible, vous ne pouvez que vous y efforcer, car les serveurs sont certainement fournis avec des systèmes de refroidissement et de surveillance qui nécessitent également une alimentation électrique. Le refroidissement peut représenter 50 à 80% de la consommation des équipements informatiques, voire plus, de sorte que le PUE moyen dans le monde est désormais de 1,67 (1 unité d'énergie va aux serveurs et 0,67 unité - aux autres équipements). Grâce à une approche intégrée, dans le meilleur des cas, le PUE peut être réduit à 1,05-1,10,et cela se traduit par des économies colossales dans l'approvisionnement en électricité.

Mais pour réaliser de telles économies, vous devrez suivre presque toutes les recommandations de notre liste de contrôle. Commençons par le simple au complexe: d'abord, nous décrirons les mesures de mise à niveau de l'équipement actuel, puis nous passerons à la réorganisation du centre de données, puis nous rêverons de transférer ou de construire de nouveaux centres de données, en tenant compte des dernières les tendances et les technologies les plus modernes.

Selon une enquête auprès des propriétaires de centres de données, beaucoup souhaiteraient améliorer l'efficacité énergétique, le refroidissement, la disposition ou l'emplacement des centres de données. Source: Magazine solaire thermique

Mise à niveau de l'onduleur pour minimiser les pertes

Pour assurer la redondance de l'alimentation, ainsi que pour protéger l'équipement coûteux du centre de données contre les surtensions et autres problèmes de réseau électrique, un onduleur en ligne avec un temps de transfert nul vers la batterie est utilisé. Pour un fonctionnement ininterrompu des serveurs, vous devez payer avec une consommation d'énergie accrue - avec une double conversion de tension afin d'augmenter ses caractéristiques, les pertes sont inévitables, qui doivent également être payées. L'efficacité de l'onduleur dépend directement de la charge - plus elle est élevée (dans les caractéristiques de l'onduleur), plus l'efficacité est grande. L'efficacité des onduleurs à double conversion en ligne actuels sous une charge élevée peut être de 85 à 95%, tandis que les modèles très obsolètes peuvent être décourageants de 40 à 50%. Autrement dit, de 15% à 50% de l'électricité disparaît lors de la transformation, mais ne disparaît pas du coût.Pour les onduleurs plus anciens, le problème du faible rendement à faible charge est particulièrement aigu.

Les systèmes UPS en ligne dédiés les plus avancés peuvent atteindre des niveaux d'efficacité allant jusqu'à 99% en fonctionnement normal. C'est pourquoi la mise à jour de la flotte d'onduleurs peut réduire considérablement le coût de maintenance d'un centre de données et augmenter considérablement le PUE. Un exemple est un onduleur d'Eaton qui a récemment attiré notre attention. Pour les petits centres de données - Eaton 9SX / 9PX compact pour 5/6/8/11 kVA (la série 9PX est équipée d'un port DB15 pour organiser le fonctionnement en parallèle de deux onduleurs). Ces onduleurs sont jusqu'à 98% efficaces en fonctionnement «haute efficacité» et jusqu'à 95% efficaces en double conversion. Chaque module est complètement autonome et peut être installé verticalement ou dans un rack 19 pouces. Pour réduire les coûts de maintenance de la batterie, le 9SX / 9PX utilise la technologie de gestion de charge Eaton ABM, qui prolonge la durée de vie de la batterie de 50%.Au lieu d'une charge d'entretien, ABM surveille le niveau de charge et ne recharge les batteries qu'en cas de besoin.

Mais pour les grands centres de données modernes, dont les propriétaires sont plus intéressés par le fonctionnement ininterrompu des équipements que par l'économie de chaque rouble, il est préférable de faire attention à l'onduleur tour Power Xpert 9395P. Ils sont efficaces à 99% en mode d'économie d'énergie ESS. Le modèle haut de gamme de la série 9395P est conçu pour 1200 kVA.

Nous mettons à jour les distributeurs d'énergie

Une chose aussi banale que les unités de distribution d'énergie (PDU ou unités de distribution d'alimentation) peut également entraîner une augmentation de la consommation d'énergie. Le but et la fonctionnalité de la PDU sont simples: surveiller la tension et la fournir à l'équipement. S'il est tentant, au stade de la planification d'un centre de données, d'opter pour des blocs de prises bon marché et non contrôlés à distance, d'éventuelles surcharges de phase peuvent entraîner des pannes de courant, et même les onduleurs n'aideront pas ici.

En outre, les PDU bon marché ont un faible rendement. Les modèles intelligents modernes et coûteux sont fournis avec un transformateur de haute qualité qui répond aux exigences élevées de la norme d'efficacité énergétique TP-1. La certification TP1 implique une augmentation de l'efficacité du PDU d'environ 2-3% par rapport aux modèles conventionnels, ce qui semble être un peu, mais une fois convertie en coûts annuels, cela se traduit par des économies agréables. De plus, les PDU modernes simplifient la gestion des câbles, aident à réduire le câblage et améliorent ainsi le flux des composants. Oui, les PDU certifiés TP-1 sont naturellement coûteux, mais les coûts sont récupérés en environ 6 ans, alors que la durée de vie de ces PDU est d'au moins 20 ans.

Remplacement de l'éclairage par LED

Par rapport à la consommation d'énergie des serveurs ou des systèmes de refroidissement, l'éclairage du centre de données représente environ 1% de toute l'électricité requise par un centre de données. Modestement, mais lorsque l'éclairage sera mis à jour, les économies se refléteront non seulement dans les factures d'électricité, mais aussi dans les devis de remplacement des lampes.

De nombreux centres de données hérités continuent d'être éclairés par des lampes au mercure écoénergétiques, qui sont inférieures aux LED dans tout sauf, peut-être, en termes de prix. Mais la ressource des lampes au mercure est environ 5 fois inférieure à celle des lampes LED. La luminosité du luminaire LED diminuera à un 70% critique de l'original en 50 000 heures, après quoi il devra être changé. Une lampe à économie d'énergie se dégrade au même niveau en seulement 10 000 heures, soit un peu plus d'un an. Ainsi, un remplacement de sources LED nécessitera jusqu'à cinq remplacements de lampes au mercure!

En outre, la luminosité des LED peut être facilement modifiée, ce qui réduit la consommation d'énergie en fonction de l'heure de la journée. Et pour obtenir le même niveau d'éclairage lors de l'utilisation de lampes LED, un tiers de moins est nécessaire que les lampes à économie d'énergie.

Utilisation du free cooling

La meilleure ressource est gratuite et renouvelable. L'air extérieur et les eaux souterraines sont une telle ressource pour le refroidissement des serveurs. Au lieu de dépenser d'énormes sommes d'argent pour le fonctionnement des refroidisseurs, il sera beaucoup plus économique de refroidir l'équipement avec du froid «hors-bord». L'approche de refroidissement gratuit, dans laquelle de l'air ou de l'eau filtrée à froid pénètre dans le système de refroidissement, est à juste titre considérée comme l'un des meilleurs moyens de réduire le coût de maintenance d'un centre de données. En abandonnant les climatiseurs au profit du refroidissement naturel, le PUE peut être garanti de diminuer de 1,8 à 1,1.

Sur la question du free cooling, les pays scandinaves sont hors compétition. Passionné par le respect de l'environnement de tout et de toute la Suède, la chaleur dans les centres de données est utilisée pour chauffer l'eau dans un système de chauffage domestique. Les Irlandais mettent les vents insulaires, pénétrant le pays même en été, au service du free cooling, et les Danois laissent de l'eau souterraine glacée dans le système de refroidissement, qui a la même basse température en hiver et en été.

Google est particulièrement fier qu'en utilisant le refroidissement gratuit dans ses centres de données européens, l'entreprise économise de l'eau qui pourrait aller aux centrales électriques pour produire de l'électricité pour les refroidisseurs (s'il y en avait). Source: Google

Le climat de la partie centrale habitée de la Russie, sans parler de la région du nord-ouest, plaît aux partisans du free cooling (et ne plaît pas à tout le monde) avec un nombre exceptionnellement petit de journées chaudes. Selon les statistiques du centre hydrométéorologique russe, dans la zone médiane du pays, seulement 3,8% du temps par an, il y a une température supérieure à + 22 ° C, et la température annuelle moyenne à Saint-Pétersbourg n'est que de + 5,6 ° C . A titre de comparaison, dans l'état américain de l'Arizona, où est construit un immense data center Apple, qui utilise également le free cooling, même en janvier la température descend rarement en dessous de +6 ° C, son niveau annuel moyen est supérieur à +16 ° C. Par conséquent, au moins un quart de l'année, Apple est obligé d'utiliser des refroidisseurs voraces pour refroidir 120 000 mètres carrés. m de la zone de votre centre de données.

Cela ne veut pas dire que le moment est venu de maîtriser les terres vierges sibériennes. Bien que le climat de la Russie soit propice à l'utilisation la plus efficace du free cooling, c'est là que s'arrêtent les avantages du nord du pays pour la construction de centres de données. Mais il y a suffisamment de lacunes: faible accessibilité des transports, pénurie de personnel hautement qualifié, mauvais état des réseaux de télécommunications et d'énergie.

Néanmoins, les premières mesures pour créer de nouveaux centres de données dans le nord ont déjà été franchies: l'Université d'État de Petrozavodsk a commencé à déployer un centre de données très sérieux, qui revendique 20% du marché russe du stockage en nuage. Dans le même temps, la météo carélienne devrait réduire les coûts d'exploitation d'environ 40%. Le personnel universitaire et les diplômés, ainsi que la proximité de Saint-Pétersbourg, résolvent parfaitement à la fois le problème du personnel et celui de la connexion à un point d'échange de trafic.

L'un des centres de données de Yandex est situé dans la Finlande froide. En raison du free cooling, son ratio PUE a été réduit à 1,1

Appeler l'IA à l'aide

La surveillance et la gestion du refroidissement d'un grand centre de données sont très laborieuses, et en même temps, il y a un grand risque de surrefroidir quelque chose, et quelque part négligé. Le fait est que l'efficacité du refroidissement est influencée par de nombreux facteurs changeants: la météo à l'extérieur de la fenêtre, la présence de fenêtres ouvertes dans les locaux, l'humidité de l'air, l'état des tours de refroidissement, la charge sur l'équipement. Il n'est pas possible pour les gens de surveiller des centaines et des milliers de paramètres en temps réel 24 heures sur 24, c'est pourquoi l'intelligence artificielle a récemment été mise au service du service de gestion du refroidissement.

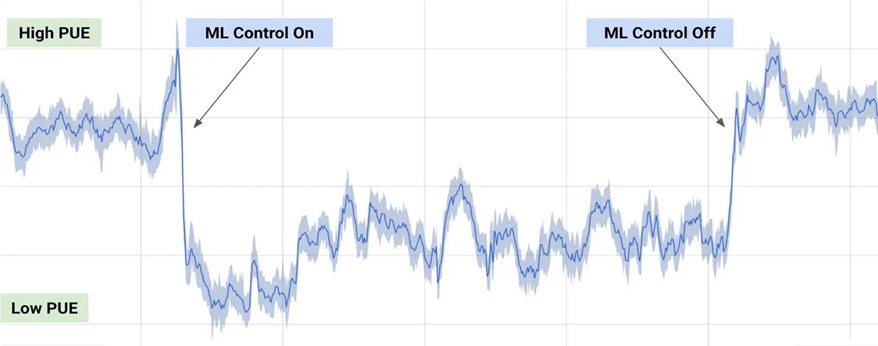

En 2014, Google a acquis DeepMind, connu pour son produit AlphaGo, qui a battu pour la première fois un joueur professionnel de go. Sur la base des développements de DeepMind, un progiciel pour le centre de données de Google a été créé, qui peut non seulement surveiller les lectures des capteurs et de la charge, mais également tirer des conclusions basées sur l'historique accumulé des observations et des prévisions météorologiques reçues. Avec l'introduction de l'IA, les coûts énergétiques pour le refroidissement des centres de données Google ont diminué d'un impressionnant 40%, tandis que tous les équipements restent les mêmes.

Le résultat du travail de AI DeepMind dans le centre de données de Google - lorsque l'apprentissage automatique était activé, le système réduisait la consommation d'énergie pour le refroidissement. Source: DeepMind

Des solutions individuelles basées sur l'IA ont trouvé leur place dans le centre de données Sberbank à Skolkovo. Étant donné que le centre de données utilise le free cooling 330 jours par an, le système surveille la température extérieure et les prévisions météorologiques et, sur cette base, optimise la consommation d'énergie pour le refroidissement et décide même de l'approvisionnement en air froid en cas de réchauffement.

La société américaine LitBit est allée encore plus loin en proposant à son collaborateur IA des data centers, qui diagnostique l'état du data center à partir de données visuelles et acoustiques. L'IA évalue le son et les vibrations émis par l'équipement et les compare aux modèles de référence pour aider à détecter les composants en dégradation.

Nous utilisons des centres de données modulaires

La construction ou l'extension d'un centre de données est non seulement un processus coûteux, mais également long, en grande partie en raison de la nécessité de concevoir une structure de capital et de réaliser un projet tout au long de la chaîne des approbations nécessaires. De la conclusion du contrat à la mise en service d'un data center compact d'une superficie de 200 à 300 m2. m 9 à 12 mois s'écoulent, à condition que les documents ne restent bloqués par aucune des autorités délivrant leurs permis de construire.

Le concept de data centers modulaires, tels des briques, à partir desquels, comme chez un constructeur, on pouvait rapidement assembler des data centers, est né au milieu des années 2000. Sun est considéré comme un pionnier dans ce domaine avec son Sun Modular Datacenter - un centre de données modulaire dans un conteneur d'expédition standard, qui peut contenir huit racks de 40 unités, des serveurs et des équipements de réseau et un système de refroidissement. Le déploiement d'un Sun Modular Datacenter modulaire a coûté environ 1% de la construction d'un centre de données traditionnel, il pouvait être facilement transporté d'un site à l'autre et la connectivité était limitée à l'électricité, à l'eau et au réseau.

2009 archive.org Sun Modular Datacenter. , — archive.org 3 50 . : NapoliRoma / Wikimedia Commons

Aujourd'hui, le marché propose des centres de données modulaires dans une grande variété de conceptions, et pas seulement sous la forme de conteneurs. Les modules sont considérés comme le moyen le plus efficace de créer ou d'étendre rapidement un centre de données sans coûts inutiles et sans longues approbations. Les modules prennent moins d'espace et utilisent l'espace plus efficacement en raison de dispositions pré-planifiées, ont moins de consommation d'énergie et souvent un meilleur refroidissement, et peuvent facilement être rapprochés des endroits où l'électricité est bon marché (à proximité de grandes centrales électriques). Donc, avant de penser à construire ou à agrandir un centre de données, vous devez faire attention aux modules prêts à l'emploi.

Alimenter le centre de données à partir de sources d'énergie renouvelables

Par rapport à l'Europe, la Russie a un avantage économique important qui rend la localisation des centres de données sur son territoire très attrayante: le coût extrêmement bas de l'électricité. Dans certaines régions du pays, il atteint 3 roubles. par kWh, tandis qu'en Allemagne environ 23 roubles. par kWh, et aux États-Unis en moyenne 9 roubles. par kWh. De plus, en Russie, les autorités ne traitent pas encore l'environnement aussi scrupuleusement que dans les pays scandinaves. Par conséquent, nous n'avons pas encore la question du transfert d'un centre de données vers une alimentation électrique autonome à partir de sources d'énergie renouvelables.

Cependant, en Occident, les propriétaires de data centers sont obligés de déclarer au moins la minimisation de leur empreinte carbone, compensant les émissions liées à l'exploitation du data center en finançant des initiatives environnementales. Ceci, ainsi que le prix élevé de l'électricité, oblige les grandes entreprises à transférer de grands centres de données vers une alimentation électrique autonome. Les coûts initiaux élevés à l'étranger sont rapidement rentables et profitent à l'image.

C'est ainsi qu'Apple, l'un des pionniers dans l'utilisation des technologies «vertes», a été le premier à transférer ses data centers vers l'électricité à partir de ses propres parcs solaires et éoliens. Il est arrivé au point qu'en 2016, la société a demandé le désir de commencer à vendre la production excédentaire de ses centrales solaires américaines d'une capacité de 90 et 130 MW.

Une alimentation électrique autonome sera utile dans les zones éloignées des réseaux électriques puissants. Par exemple, le centre de données islandais Verne Global est construit par un certain nombre de centrales géothermiques. Bien qu'elles n'appartiennent pas à l'entreprise, elles sont des sources d'énergie respectueuses de l'environnement, renouvelables et très durables.

En Allemagne, l'énergie verte représente déjà plus de la moitié de l'ensemble de la production. Malheureusement, la part des énergies renouvelables en Russie oscille autour de 4%, dont les deux tiers sont de l'hydroélectricité. Mais pour les nouveaux centres de données, comme base pour l'avenir, il ne fera pas de mal de penser à une alimentation électrique autonome à partir d'une centrale solaire ou éolienne.

L'épargne n'est jamais superflue

Le centre de données le plus grand et le plus cher du monde appartient au géant des télécommunications China Telecom. Il couvre une superficie de 994 mille mètres carrés. m, et la construction a coûté 3 milliards de dollars. Le plus grand centre de données russe a été construit par Sberbank à Skolkovo. Il est 30 fois plus petit que le géant chinois - seulement 33 000 mètres carrés. Mais grâce à la mise en œuvre compétente du refroidissement gratuit, de l'IA et du chauffage des locaux avec des équipements de chauffage, il a été possible de réaliser des économies sur l'entretien d'environ 100 millions de roubles par an. Compte tenu de la taille du centre de données de China Telecom, vous pouvez être sûr que tous les moyens possibles de réduire les coûts y ont également été appliqués. Aussi absurde et insignifiante qu'une mesure de réduction du coût de maintenance du datacenter puisse paraître, elle peut apporter en termes annuels des économies très notables, proportionnelles à la taille du datacenter.