Auteur : Eugenio Culurciello, titre original : La chute de RNN/LSTM

Traduction : Davydov A.N.

Nous avons adoré les RNN (Recurrent Neural Networks), les LSTM (Long-short term memory) et toutes leurs variantes. Et maintenant il est temps de les abandonner !

En 2014, LSTM et RNN ont été ressuscités. Mais nous étions jeunes et inexpérimentés. Depuis plusieurs années, ils sont un moyen de résoudre des problèmes tels que l'apprentissage séquentiel, la traduction de séquences (seq2seq). Ils ont également permis d'obtenir des résultats étonnants dans la compréhension de la parole et sa traduction en texte. Ces réseaux ont alimenté la montée en puissance des assistants vocaux tels que Siri, Cortana, Google et Alexa. N'oublions pas la traduction automatique, qui nous a permis de traduire des documents dans différentes langues. Ou la traduction automatique par réseau de neurones, qui vous permet de traduire des images en texte, du texte en images, de créer des sous-titres pour des vidéos, etc.

Puis, dans les années suivantes (2015-16), ResNet et Attention sont apparus. Ensuite, on a commencé à comprendre que le LSTM était une technique intelligente pour contourner, pas pour résoudre un problème. L'attention a également montré que les réseaux MLP (Multi-Layer Perceptron Neural Networks) peuvent être remplacés par des réseaux de moyennage pilotés par un vecteur de contexte. (plus à ce sujet plus tard).

Seulement 2 ans se sont écoulés, et aujourd'hui nous pouvons dire avec certitude :

« Approchez RNN et LSTM, ils ne sont pas si bons ! »

, , Attention , , . RNN Attention . RNN , , Attention.

?

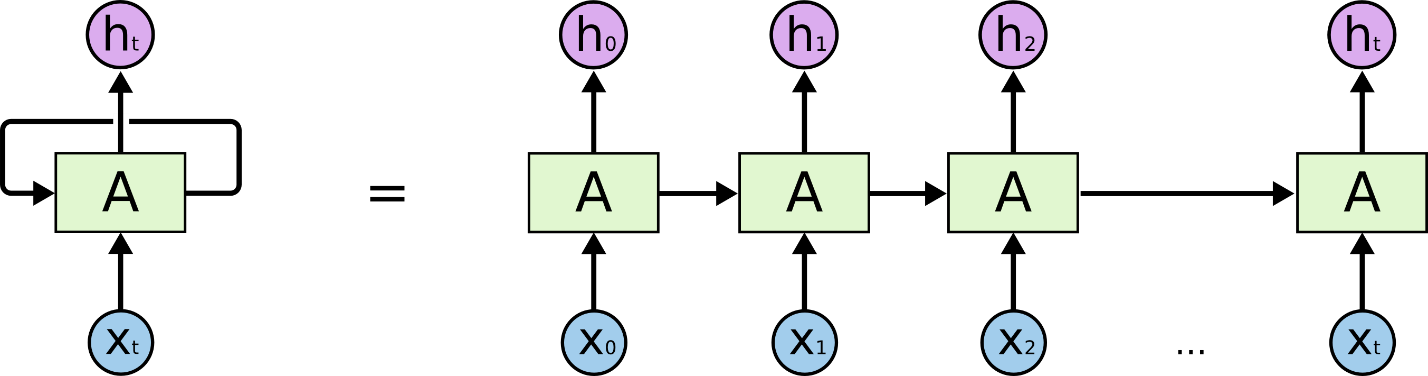

, RNN, LSTM . :

, , . , , 0, .

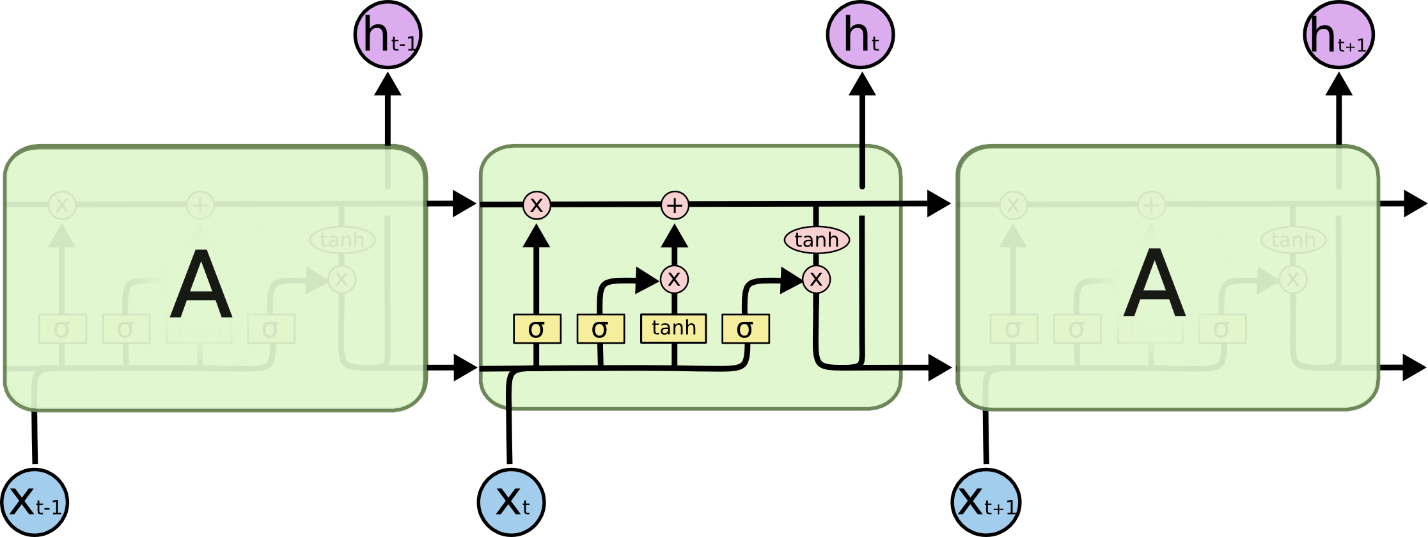

LSTM. , , ResNet. () . LSTM . .

. , , . , LSTM, GRU ! (100), .

RNN , . , ( ), . RNN . , , , Amazon Echo!

?

2D , RNN/LSTM, Attention, Transformer

Transformer 2017 , . , .

: , , « » , « », - ( ) , , . , / .

« », , :

- , Ct

, , . (TCN), 3 .

«» , 100 , 100 «» 100 . 100100 . 10 000 .

, .

, , , : , N (log(N)), N – . , RNN, – . T N (T>>N)

, 3-4 100!

, , «». , , .

? , . , , : , – , . , , . , . , , , .

– RNN . Attention. , - , !

RNN\LSTM: RNN LSTM , , . , LSTM 4 ( MLP) . , , . , ( , . .). RNN / LSTM , . , , FWDNXT.

1: WaveNet. . : .

2: RNN LSTM - ( . ). () , / , ! , - . - , ( ).

3: , CNN RNN. (TCN) « , LSTM, , ».

4: , , . « , , 858 534 22 30, . , »- , «» (Attention), , , (TCN). , RNN, , . , (, 5 ), , , , .

5: , , , . «» . , ! !

6: Attention Transformer, . VGG NLP? , LSTM , . LSTM Transformer ( ), , , « LSTM Transformer - MRPC »